loaction

서울대 컴퓨터공학부 전병곤 교수팀 딥러닝 모델 분산 학습 시스템 Parallax 개발

-

작성자

관리자

-

등록일

2019.01.07

-

조회수

1,699

서울대 컴퓨터공학부 전병곤 교수팀

딥러닝 모델 분산 학습 시스템 Parallax 개발

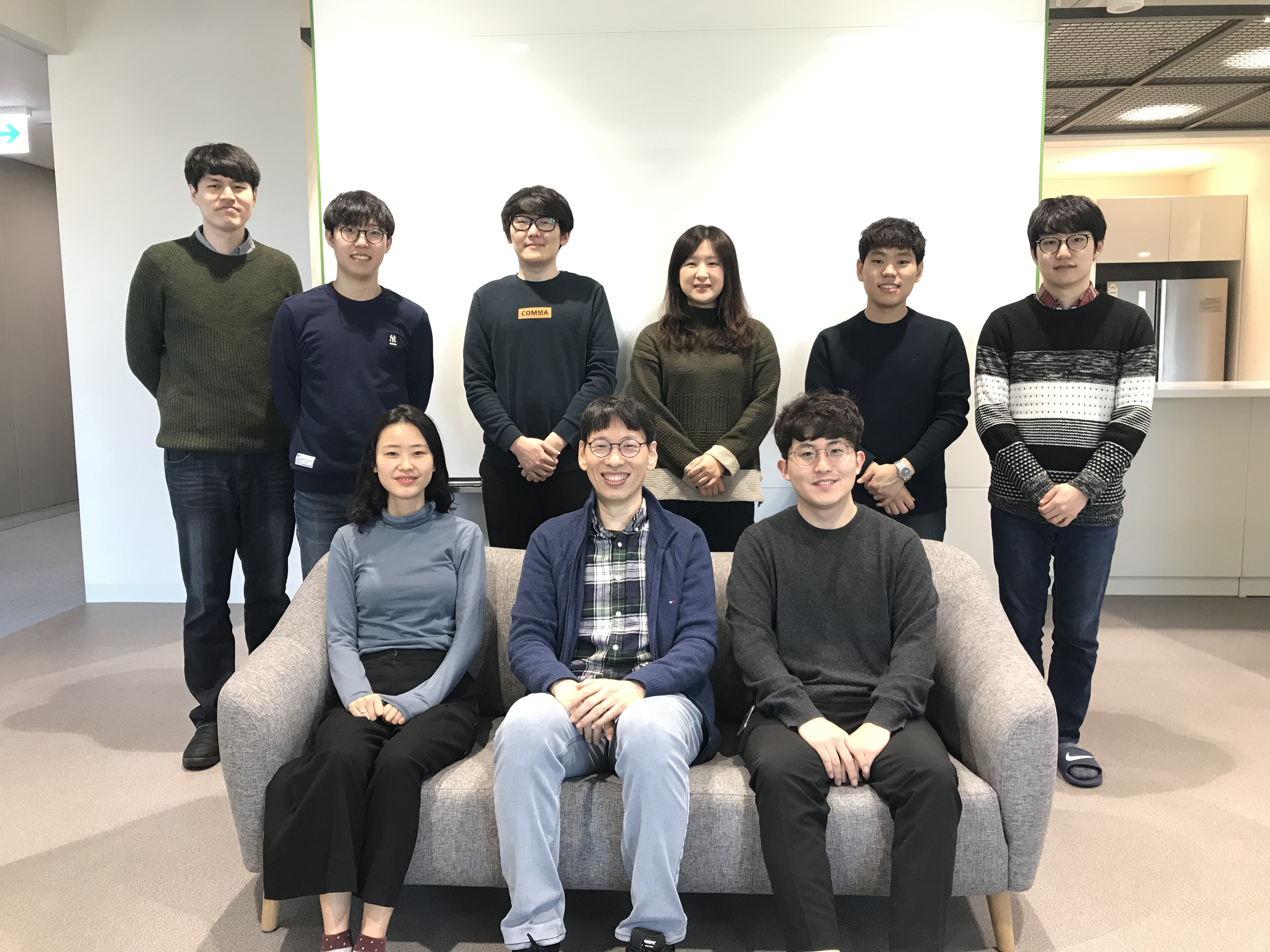

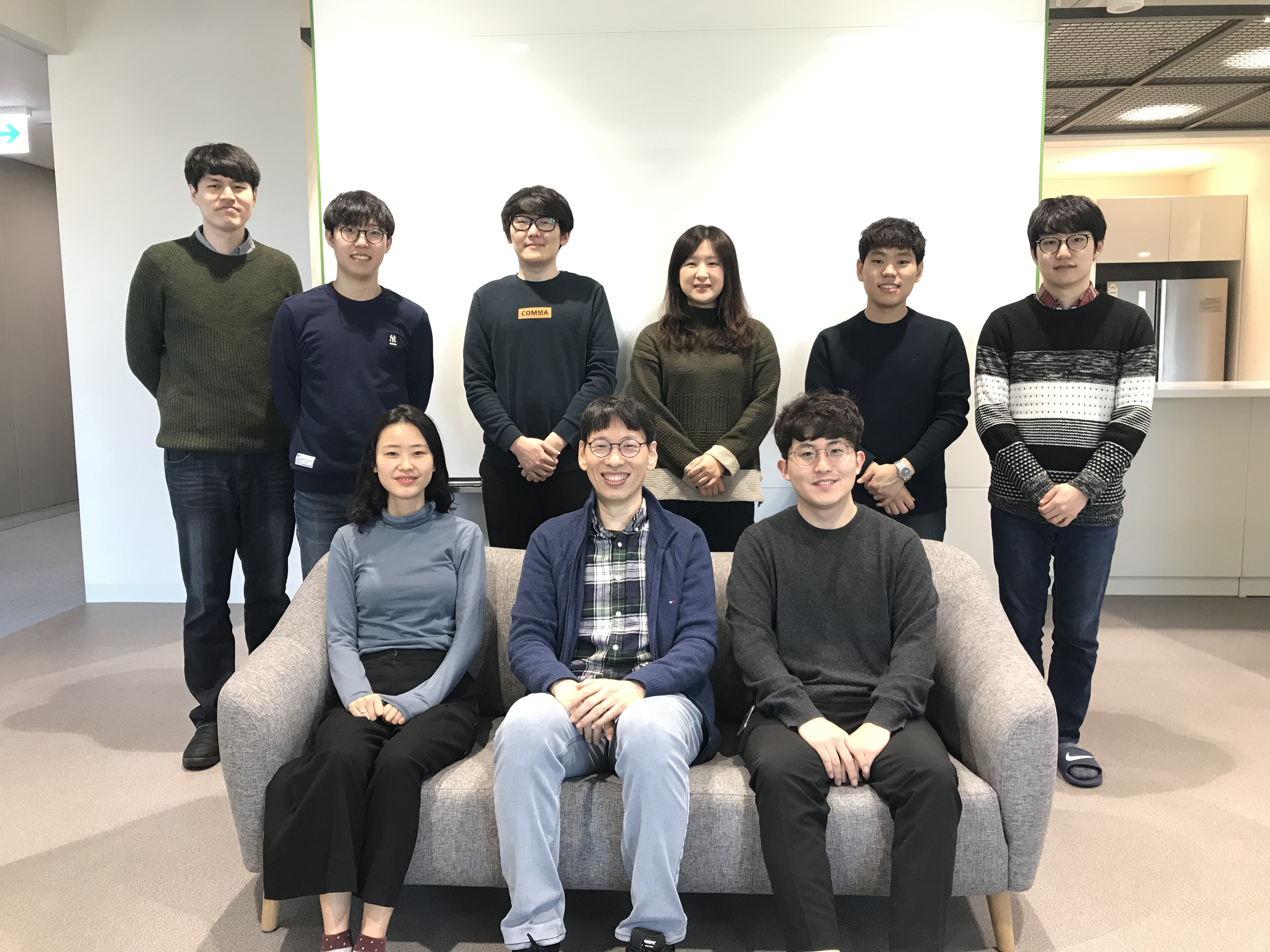

▲ 서울대 컴퓨터공학부 전병곤 교수팀 (아래 왼쪽부터) 김수정 박사과정, 전병곤 컴퓨터공학부 교수, 유경인 박사과정, 정주성 박사과정, 박호진 학사과정, 하현민 박사과정, 정은지 박사과정, 이산하 석사과정, 조성우 석사과정

딥러닝 모델 분산 학습 시스템 Parallax 개발

▲ 서울대 컴퓨터공학부 전병곤 교수팀 (아래 왼쪽부터) 김수정 박사과정, 전병곤 컴퓨터공학부 교수, 유경인 박사과정, 정주성 박사과정, 박호진 학사과정, 하현민 박사과정, 정은지 박사과정, 이산하 석사과정, 조성우 석사과정

서울대 공대는 컴퓨터공학부 전병곤 교수팀이 딥러닝 모델을 자동으로 빠르게 분산 학습하는 시스템인 Parallax를 개발했다고 3일 밝혔다.

딥러닝 기술은 이미지 처리, 음성 인식, 자율주행 등 다양한 분야에서 활용되고 있다. 최근 딥러닝 모델의 학습시간을 단축시키기 위해 많은 GPU를 사용하는 분산 학습에 관한 연구가 활발히 이뤄지고 있다.

기존의 연구는 희소 텐서 보다는 대부분 밀집 텐서를 사용하는 이미지 처리를 위한 모델에 대한 연구에 치중됐다. 자연어 처리를 위한 모델은 이미지 처리를 위한 모델과는 다르게 사용되는 파라미터의 희소성이 크다. 하지만 기존 분산 학습 시스템들은 이런 파라미터의 희소성을 잘 활용하지 않아 희소 파라미터가 포함된 모델의 분산 학습 성능이 밀집 파라미터만 사용하는 모델에 비해 상대적으로 낮은 편이었다.

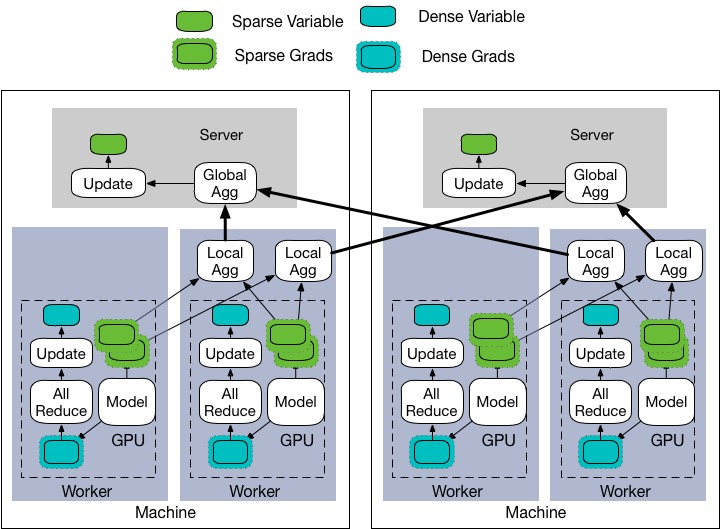

이에 연구팀이 제안한 Parallax는 파라미터 희소성을 고려한 최적화 기술을 통해 빠르게 분산학습이 가능한 시스템이다. Parallax 시스템에서는 파라미터의 희소성에 따라 밀집 파라미터와 희소 파라미터에 각각 다른 학습 아키텍처 방식을 혼용한 하이브리드 분산 학습 아키텍쳐를 사용한다.

또한 머신 별로 미리 데이터를 처리하고 크기를 줄인 뒤 다른 머신에 전송함으로써 머신 간 통신량을 줄이고 크기가 큰 희소 파라미터를 효율적으로 처리하기 위한 파티셔닝을 사용한다. 그 결과 이미지 처리 모델의 성능은 유지하면서 자연어 처리 모델의 성능은 기존 시스템 대비 최대 6배 향상시켰다. 이와 함께 하나의 GPU에서 개발한 모델을 많은 GPU에서 학습할 수 있도록 자동으로 변환하여 사용성을 크게 증가시켰다.

해당 연구 결과는 2019년 3월 독일 드레스덴에서 개최될 시스템 분야 최고 우수 학회 중 하나인 EuroSys(European Conference on Computer Systems)에서 발표될 예정이다.

[참고자료]

출판 전 논문 페이지: https://arxiv.org/abs/1808.02621 (최종 출판본은 2019년 3월 공개 예정)

[그림1] Parallax의 하이브리드 분산 학습 아키텍쳐의 적용 예시. 하나의 모델을 분산 학습 할 때 밀집 파라미터(Dense Variable)는 AllReduce를 이용하는 분산 아키텍쳐를 활용하고, 희소 파라미터(Sparse Variable)는 파라미터 서버 아키텍쳐를 적용한다